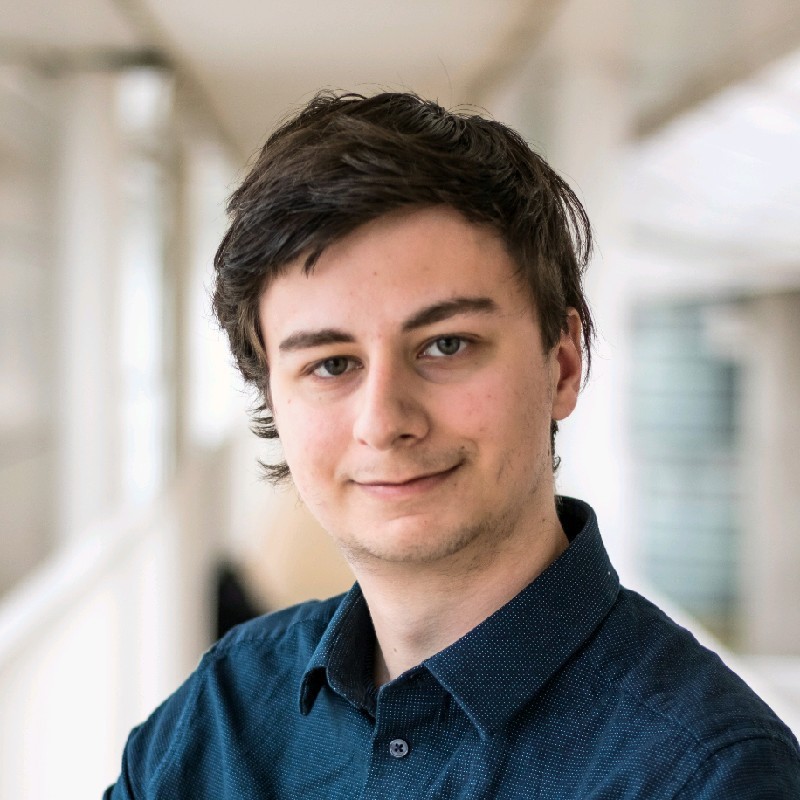

Bonjour, je suis

Antoine Gélin

Data Engineer avec 5 ans d'expérience — pipelines d'ingestion, entrepôts de données, couches BI. Background Java/Spark sur de gros volumes, aujourd'hui centré sur la Modern Data Stack (dbt, Redshift, AWS).

/ Expertise

Les domaines dans lesquels j'interviens

Pipelines de données

Conception et mise en production de pipelines d'ingestion et de transformation. Approche ELT moderne avec orchestration, tests et monitoring intégrés.

Architecture data warehouse

Modélisation et structuration d'entrepôts de données optimisés pour l'analytique : schémas en étoile, couches staging/mart, conventions de nommage.

Infrastructure cloud

Déploiement et gestion d'infrastructures data sur AWS et GCP : stockage, compute, orchestration, le tout versionné et reproductible.

BI & visualisation

Mise en place de couches BI en libre-service : dashboards métier, KPIs automatisés, accès autonome aux données pour les équipes non techniques.

Qualité & observabilité

Intégration de tests de données, alertes et monitoring dans les pipelines pour garantir la fiabilité et détecter les anomalies avant qu'elles n'impactent les usages.

Accompagnement & documentation

Transmission de connaissances, documentation technique, formation des équipes métier ou tech pour assurer l'autonomie sur les outils data.

/ Projets

Une sélection de projets professionnels et expérimentaux.

Plateforme ELT serverless sur Google Cloud pour les données Vélib' Métropole : ingestion haute fréquence (~200M observations/an), stockage colonnaire BigQuery, transformations analytiques dbt, infrastructure versionnée Terraform.

/ Stack Technique

Compétences techniques par domaine et niveau de maîtrise

Data Engineering

Bases de données

Cloud & DevOps

Langages

/ Contact

N'hésitez pas à me contacter pour discuter de nouveaux projets.